PRESS RELEASE

2024年12月12日

富士通株式会社

作業効率化や安心・安全な現場づくりに向けた改善を自律的に支援する映像解析型AIエージェントを開発

業務に関わる映像とドキュメントから空間把握能力と時系列理解能力を強化

当社は、このほど、AIサービス「Fujitsu Kozuchi」のコア技術として、製造、物流などの現場に設置されたカメラ映像を空間認識し解析するとともに作業指示や規則などのドキュメント情報を参照することで、自律的に現場改善の提案や作業レポートの作成を行い、人の作業を支援する映像解析型AIエージェントを開発しました。当社は、開発したAIエージェントを用いて2025年1月より社内実践を行うとともに、2024年度中に映像解析型AIエージェントのトライアル環境の提供を開始します。また今後、店舗、交通、公共安全などの様々な分野への技術展開も進めていきます。

開発したAIエージェントでは、マルチモーダル(注1)大規模言語モデル(以下、マルチモーダルLLM)をベースとし、安全規則などのドキュメント情報をもとに現場の3次元空間を映像認識する能力を獲得する自己学習技術と、ドキュメントのコンテキストが示す対象部分を映像から選択し記憶することにより、長時間の映像を世界最高精度(注2)で解析することを可能にしたコンテキスト記憶技術を搭載しています。

さらに、AIエージェントの性能評価を目的に、工場や倉庫の現場映像を含むAIエージェントの評価環境「FieldWorkArena(フィールドワークアリーナ)」を、米国のCarnegie Mellon University(注3)(以下、カーネギーメロン大学)の監修のもと開発しました。2024年12月より、「FieldWorkArena」の公開をGitHub(注4)およびFujitsu Research Portalにおいて開始する予定です。

背景

製造や物流をはじめとする現場において人材不足や熟練者の高齢化が進む中、生産性や品質を確保しながら、働きやすく安心・安全な現場づくりを実現していくことが課題となっています。人と協調するAIエージェントは、デスクワークや会話支援において大きな広がりを見せていますが、現場作業の支援に向けてはさらなる進化が求められています。

開発技術

開発した映像解析型AIエージェントは、以下の特長を備えています。

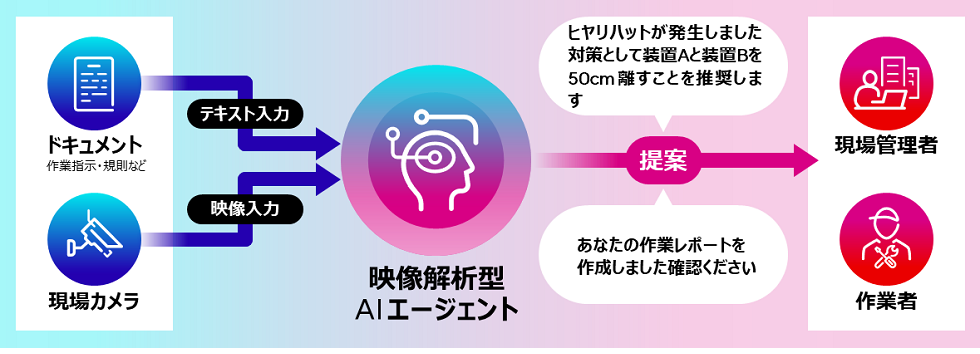

図1:映像解析型AIエージェント

図1:映像解析型AIエージェントドキュメント情報をもとに現場理解能力の拡張を行う自己学習技術

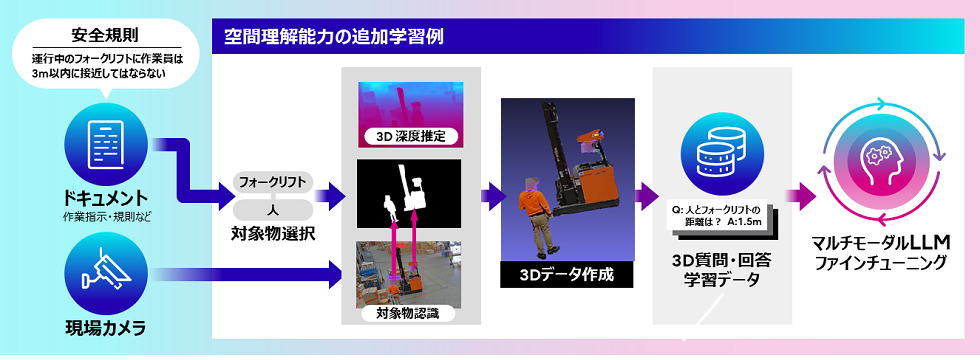

人間は初めて見る物や場所でも、指示書などの言語情報をもとに視覚情報を理解し、作業を行うことができます。本技術では、マルチモーダルLLMが映像から認識できない事象について、ドキュメントの言語情報を対応付けて学習し、AIエージェントの映像理解能力を拡張することができます。図2は、人と物との空間的関係性の理解能力を拡張する例です。まず、ドキュメントに含まれる対象物を選択し、機械学習により対象物との距離を推定して3次元データを仮想空間上に作成します。次に、ドキュメントから作成した質問と、3次元データからわかる回答を作成し、それらを学習データとしてマルチモーダルLLMをファインチューニングします。この技術を用いて人と物体の距離を3次元で推定することで、物流や建設の現場における安全管理や、製造現場における作業状況の生産管理システムへの自動入力などを実現します。また、空間理解能力に加え、現場固有の物体認識、人の個別作業の認識など、現場作業支援に必要な様々な能力をAIエージェントに追加できるようになります。

図2:現場理解能力の追加学習の例

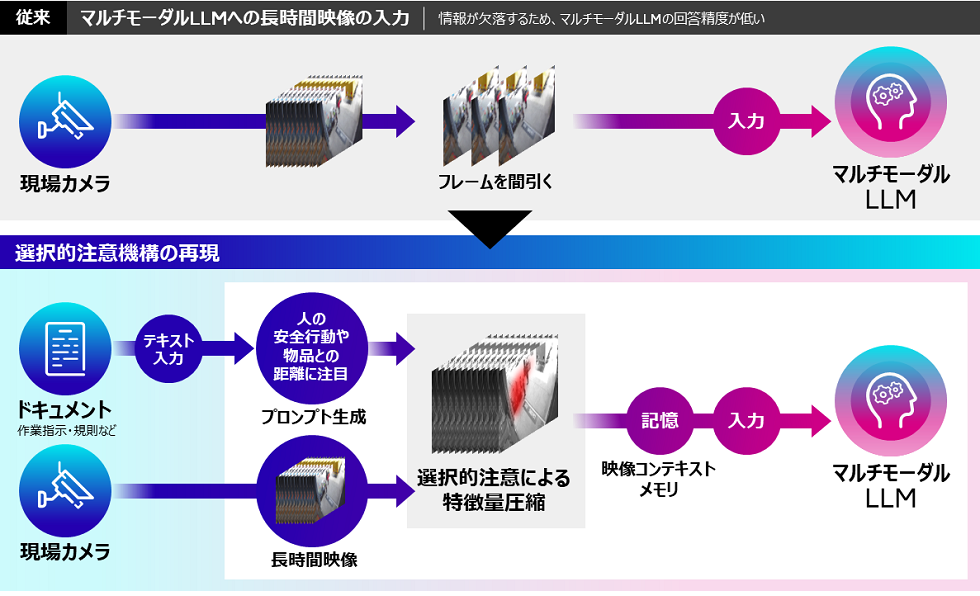

図2:現場理解能力の追加学習の例映像を効率的に解析するコンテキスト記憶技術

マルチモーダルLLMでは、サイズの大きい長時間の映像を入力する際にフレームを間引くため、時系列で変化のある映像を分析する際に回答の精度が落ちるという問題がありました。この問題を解決するために着目したのが、重要な情報に注意を集中することで効率的に視覚情報を処理する、人間の「選択的注意」というメカニズムです。本技術では、対象映像の中でAIエージェントのタスクで検知したい「人の安全行動」などの主題をプロンプトとして与えると、「選択的注意」により、主題に適合するフレーム内の特徴量のみを選択し、圧縮して映像コンテキストメモリとしてビデオメモリに格納します。映像コンテキストメモリを用いることで、フレームを間引くことなく長時間映像をマルチモーダルLLMが扱えるようになります。2時間以上の映像を含む長時間映像に対する質問回答のベンチマークを行った結果、開発方式は従来のマルチモーダルLLM向けの映像圧縮技術と比較して最小の記憶容量で世界最高の回答精度を達成しました。

図3:選択的注意機構を用いた映像のコンテキスト記憶

図3:選択的注意機構を用いた映像のコンテキスト記憶AIエージェント評価環境「FieldWorkArena」

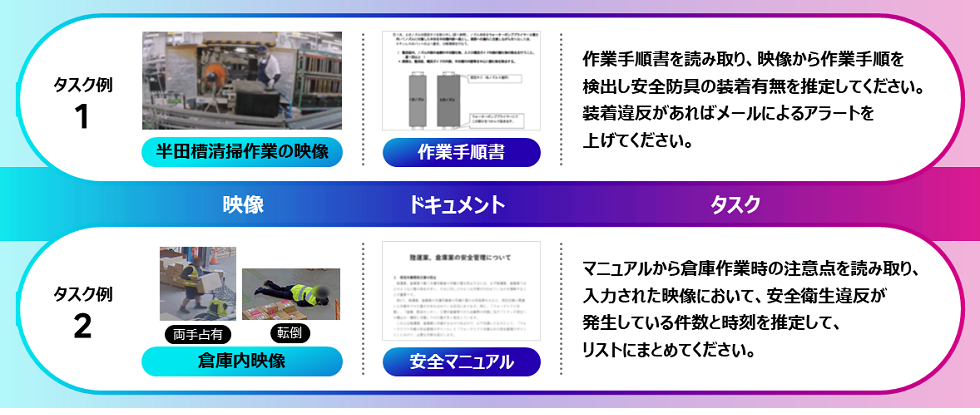

当社は、映像解析型AIエージェントのための評価環境「FieldWorkArena」を、カーネギーメロン大学のグラム・ニュービッグ准教授、ヨナタン・ビスク助教授のチームの監修のもと開発しました。「FieldWorkArena」には、実際の工場や倉庫の画像や映像、規則や手順書などのドキュメント、模擬の業務システム、AIエージェントが解決すべきタスク群が含まれ(図4)、AIエージェントの実業務での性能を評価することができます。

図4:「FieldWorkArena」のデータ、タスク例

図4:「FieldWorkArena」のデータ、タスク例商標について

記載されている製品名などの固有名詞は、各社の商標または登録商標です。

注釈

-

注1マルチモーダル:

複数の形式や手段を組み合わせること。注2世界最高の回答精度を実現:

長時間映像理解ベンチマークInfiniBenchのうち、映像情報のみで回答可能な599のサブセット(平均49分・最大151分の映像)に対しての回答精度で世界最高記録を達成(2024年12月12日現在)注3Carnegie Mellon University:

所在地 米国ペンシルベニア州、学長 Farnam Jahanian注4GitHub:

世界中でオープンソースソフトウェアの公開に使われているプラットフォーム。https://github.com/関連リンク

当社のSDGsへの貢献について

2015年に国連で採択された持続可能な開発目標(Sustainable Development Goals:SDGs)は、世界全体が2030年までに達成すべき共通の目標です。当社のパーパス(存在意義)である「イノベーションによって社会に信頼をもたらし、世界をより持続可能にしていくこと」は、SDGsへの貢献を約束するものです。

本件が貢献を目指す主なSDGs

本件に関するお問い合わせ

-

富士通コンタクトライン(総合窓口)

0120-933-200(通話無料)受付時間: 9時~12時および13時~17時30分(土曜日・日曜日・祝日・富士通指定の休業日を除く)

-

Webでのお問い合わせ

入力フォームへ当社はセキュリティ保護の観点からSSL技術を使用しております。

プレスリリースに記載された製品の価格、仕様、サービス内容などは発表日現在のものです。その後予告なしに変更されることがあります。あらかじめご了承ください。